Продвигаться через органику и без того сложная задача, так еще и ниша iGaming имеет свои отличительные черты, которые делают процесс еще труднее. Чтобы помочь, сегодня мы расскажем, как работать с SEO трафиком, какие там крутятся бюджеты и в чем особенности оптимизации гемблинг трафика в этой конкретной вертикали.

В чем особенность SEO-оптимизации и продвижения в гемблинге

Самое первое, что нужно понять при работе с SEO трафиком в гемблинге — открыто продвигаться у вас не выйдет. Google, Яндекс и другие поисковые системы тщательно отслеживают и отсеивают контент, связанный с казино, ставками и другими азартными играми.

Гемблинговые сайты блокируют во многих странах из-за запретов местных властей. В этой ситуации большинство компаний делают сайты-подкладки с информацией и продвигают их в поисковой выдаче, чтобы уже оттуда новые игроки попадали на страницы онлайн-казино.

Эти сайты можно разделить на три категории: монобрендовые, обзорники и страницы под конкретные слоты.

Если же вы решили продвигать сайт в iGaming, будьте готовы к тому, что в гемблинге очень высокая конкуренция и требовательная аудитория, заполучить которую еще сложнее, если заливаться на страны Tier-1.

Вопрос при выборе ГЕО состоит в том, насколько сложно будет завоевать позиции, и именно здесь важен анализ конкурентов. Через него вы сможете наметить примерные бюджеты, способы и сроки продвижения проекта.

Например, если у конкурентов тонна упакованных ссылок, придется искать хороший дроп с длинной историей и качественных доноров для ссылочного продвижения. Если же анализируемые страницы делают упор на контент, возможно, стоит применить тактику с монобрендовым сайтом, который отхватит позиции хотя бы по одному казино.

Как SEO-продвижение отличается в СНГ и в бурже

Чтобы понять, как продвигать гемблинг, нужно определиться с ГЕО для залива. В одной только Америке пользователей сети больше, чем в РФ и СНГ вместе взятых. Вместе с тем, конкуренция за внимание юзера там гораздо выше, поэтому и продвигаться не в пример сложнее.

Например, SEO — один из самых важных источников гемблинг трафика в бурже, потому что нет лучше человека, чем тот, который сам заинтересован и ищет, где бы покрутить слоты. По этой причине органика остается самым любимым источником трафика у рекламодателей в гемблинге.

Плюс при выборе ГЕО важно понимать менталитет и традиции вашей целевой аудитории. Например, одна из главных ценностей для итальянцев — это семья, поэтому сайты и реклама, показывающие совместную радость от победы или пользу, которую можно принести своим близким, выстрелят там лучше.

Если говорить именно об офферах, то в первую очередь нужно смотреть на брендовые запросы, а также на маркетинг продукта. Во многих нишах в начале необходимо провести огромную работу, чтобы бренд гуглили, и только потом начинать привлекать брендовый SEO трафик на продукт.

Фундаментальная формула эффективного SEO продвижения в любой вертикали — это скорость сайта плюс качественные тексты и ссылки. Нюансы зависят от конкретного ГЕО или продукта, двух одинаковых случаев тут нет.

Сколько стоит SEO продвижение в гемблинге в разных ГЕО

Если же вы все-таки решили работать в гемблинге, на проект нужно будет выделить бюджет и нанять себе команду спецов, которая тонко настроит оптимизацию.

На что неизбежно придется потратиться:

- Контент: статьи, обзоры и рейтинги;

- Ссылки и домены для подклейки особенно важны для офферов в iGaming, поэтому SEO-специалисту точно понадобится закупать их:

- Outreach-ссылки на известных и трастовых сайтах;

- Сrowd-ссылки на форумах;

- Ссылки из соцсетей, чтобы индексация шла быстрее;

- Сквозные ссылки, размещаемые в меню других сайтов;

- Зеркала или редиректы.

- Домены, хостинги и так далее.

Работать можно с самыми разными ГЕО: Азия, СНГ, Европа, Северная или Южная Америка — любители азарта есть в любой точке мира. Другое дело, что гемблинг — очень конкурентная ниша, отсюда и большие бюджеты на продвижение.

Но сколько реально понадобится денег?

- В некоторых регионах бюджеты на ссылки могут достигать нескольких тысяч долларов;

- Большая база качественных текстов — вторая по значимости вещь после ссылок, поэтому сюда также легко потратить сотни и тысячи долларов;

- Если говорить о разработке, то простой отзовик на WordPress будет стоить недорого, тогда как крупный агрегатор казино влетит вам в копеечку.

На выходе получаем, что в хороший брендовый сайт под отдельное онлайн-казино можно потратить полторы-две тысячи долларов, тогда как большой портал с обзорами легко опустошит ваши карманы на 10-15 тысяч американских президентов.

Как продвигать гемблинг через SEO трафик

Мы сделали подробные инструкции по созданию, запуску и продвижению сайта под SEO трафик на гемблинг для каждого из трех видов страниц.

Самые лучшие сервисы для работы с органическим трафиком:

- Ahrefs — целый инструментарий для работы с SEO: анализ внешних ссылок, отслеживание конкурентов, аудит и оптимизация сайта и многое другое;

- Google Analytics — можно встроить в сайт и отслеживать статистику;

- Google Search Console — показывает, как страница показывается в поисковой выдаче;

- Key Collector — утилита для сбора семантического ядра;

- Semrush — гибкий сервис с кучей функций, умеет оценивать актуальность профилей ссылок;

- Screaming Frog SEO Spider — программа для технического SEO-аудита сайтов;

- Mobile-Friendly Test — API для проверки соответствия сайта под мобильные устройства;

- PageSpeed Insights — утилита, которая оценивает скорость загрузки сайта.

Брендовые или монобрендовые сайты

В этом случае сайт для привлечения SEO трафика в гемблинге создается под один конкретный оффер, который востребован у игроков. На основную страницу онлайн-казино юзеров не ведут — вместо них используются «зеркала» — точные копии сайта на других серверах, которые помогут игрокам обходить блокировки в их регионах.

Перед тем, как создавать и продвигать такой сайт, стоит уточнить, разрешен ли в вашей партнерке SEO трафик. Часть CPA-сеток запрещает его из-за опасения потерять собственную органику. Дело в том, что для работы с брендовым гемблинг трафиком SEO-специалисту в процессе оптимизации нужно обойти оригинальный сайт в поисковой выдаче, отсюда и такая позиция.

Выбираем оффер и партнерку

Важно, чтобы CPA-сетка принимала органический трафик. Желательно, чтобы допускались и другие источники: соцсети, рассылки и push-уведомления.

Анализируем рынок

При работе в СНГ проверяем ключи, связанные с конкретным казино, в Яндекс Wordstat. Что искать: название самого казино плюс слова «обзор», «играть», «слоты», «слот + играть» и так далее.

Если предстоит продвижение в других ГЕО, идем в Google Ads, выбираем нужную страну и смотрим спрос. Делать сайт под казино можно, если есть хотя бы 100+ запросов.

Запускаем сайт с парой десятков страниц

Настраиваем каждую страницу сайта под группу запросов. Например: первая — «Мелбет + обзор», вторая — «Мелбет + играть», третья — «Мелбет + слоты» и так далее.

Пишем качественные тексты под каждую страницу

Тексты нужно оптимизировать, внести все ключевые слова, которые вы собрали, и дать ответы на запросы, закрыть боли пользователей.

Закупаем ссылки

На сайте нужно будет проставить анкорные ссылки на сайт с теми же вхождениями, к примеру — «Мелбет + обзор».

Страницы под конкретные слоты

Можно встретить как лендинги, так и сайты с 5-10 страницами, которые рекламируют посетителям отдельную игру с платформы онлайн-казино. Вебмастеры либо ведут SEO трафик с таких страниц на «зеркало», либо копируют интерфейс слота прямо на месте, чтобы удержать игроков.

Для продвижения лучше выбирать игры, которые любят и в которые постоянно играют: Aviator, Book of Ra, Crazy Monkey и так далее.

Вот, что предстоит сделать здесь:

- Выбираем пачку игр — лучше такие, о которых знают в разных ГЕО;

- Собираем семантику по каждому слоту, чтобы оценить потенциальную выгоду с продвижения каждого. Спрос лучше смотреть сразу в нескольких ГЕО по одному языку;

- Смотрим, что там у конкурентов, чтобы понять, как там работают и насколько сложный рынок;

- Все данные собираем в сводную таблицу и выводим один или два лучших слота для работы.

Как и с брендовым сайтом, надо будет собирать ресурс с учетом запросов юзеров. Например:

- Страница с обзорами: «название слота + обзор», «название слота + официальный сайт»;

- Страница со стратегиями: «название слота + тактика», «название слота + как выиграть», «название слота + стратегия обыгрыша»;

- Отзывы и рецензии: «название слота + отзывы», «название слота + мнение игроков»;

- Страница действия: «название слота + скачать», «название слота + играть онлайн» и так далее;

- Страница с демо-версией игры: «название слота + играть бесплатно», «название слота + тестовый аккаунт».

Особенно тщательно нужно будет настроить страницу с отзывами — для хорошей позиции в поиске она имеет определяющее значение.

Сайты с обзорами онлайн-казино

Еще один популярный вариант для всех, кто ищет ответ на вопрос «как продвигать гемблинг». У всех таких страниц более-менее одинаковая структура: составляется рейтинг iGaming-площадок с подробным описанием каждой, после чего пишутся отзывы.

Плюс такого сайта в том, что на нем можно продвигать хоть 50 офферов под трафик на гемблинг одновременно, однако делать подобный ресурс в одиночку слишком сложно — здесь не обойтись без помощи как минимум верстальщика, копирайтера и дизайнера.

Плюс нужно быть готовыми к тому, что без очень широкой семантики он не заработает. Главное, что предстоит сделать — через обзоры и рейтинги дать максимально полные ответы на все запросы аудитории.

Чем дольше работает такой портал, тем сильнее разрастается. Самые крупные из них могут содержать сотни и тысячи страниц.

Их главное преимущество — можно охватить весь спрос в тематике гемблинга и привести пользователей в разные онлайн-казино. Основной недостаток — нужно намного больше времени на развитие и много средств на продвижение. Ниже мы собрали пошаговый план развития многостраничного портала.

Как собрать сайт-обзорник: подробная инструкция

Шаг 1: выбираем офферы

Хоть это и сложнее, лучше всего будет охватить сразу как можно больше популярных офферов. Например, грамотный сайт с обзорами хорош тем, что вы даете юзеру выбор, во что играть — это положительно влияет на лояльность и срок взаимодействия с онлайн-казино. SEO-специалист, работающий по такой стратегии, получит больше денег с ревшары.

Шаг 2: анализируем конкурентов и рынок

Одно из важнейших правил и для арбитражника, и для SEO-специалиста, в какой вертикали бы он ни работал. Для привлечения гемблинг трафика уже нет простых ГЕО. Например, года 2 назад было принято считать, что Индия и Бразилия — золотые жилы. Сегодня первая перегрета, а во вторую лезут все, кому не лень.

Программы-шпионы, с которыми можно удобно просматривать и анализировать ссылочные профили конкурентов:

Шаг 3: собираем семантическое ядро

Семантика — сердце SEO-оптимизации. В типичные группы ключей входят по общим темам:

- топ онлайн-казино;

- лучшие онлайн-казино;

- казино с лучшими условиями для новых игроков.

Также в семантическое ядро всегда попадают брендовые запросы, например:

- Pin Up обзор;

- Азино 777 обзор;

- Мелбет обзор и так далее.

Чем шире будет семантика, тем больше способов и страниц для привлечения пользователей вы получите.

Семантика будет меняться со временем, поэтому стоит иногда перепроверять и обновлять ключи. Новые площадки, слоты и игры означают новые пути, по которым пользователь может пройти именно на ваш сайт.

Если вовремя отслеживать изменения и создавать посадочные страницы под свежие запросы, объемы SEO трафика не будут падать со временем.

Шаг 4: если сайта нет, подбираем дроп

Чем дольше домен крутится в сети, тем больше за ним истории, которая влияет на его репутацию. SEO-специалисты оборачивают эту особенность в свою пользу, покупая домены с историей: ссылками и положительными результатами.

Если размещать свои сайты на плюсовых доменах, проект будет развиваться гораздо быстрее.

Однако тут есть своя сложность: самостоятельно купить стоящий сайт для привлечения трафика на гемблинг практически невозможно.

Большинство SEO-специалистов обращаются к специалистам по выкупу сайтов, которые сейчас де-факто контролируют рынок — почти все хорошие ресурсы покупают их посредники.

Если же решили создавать свой сайт, то лучший движок для ресурса по iGaming — WordPress. В нем даже есть готовые шаблоны под гемблинг.

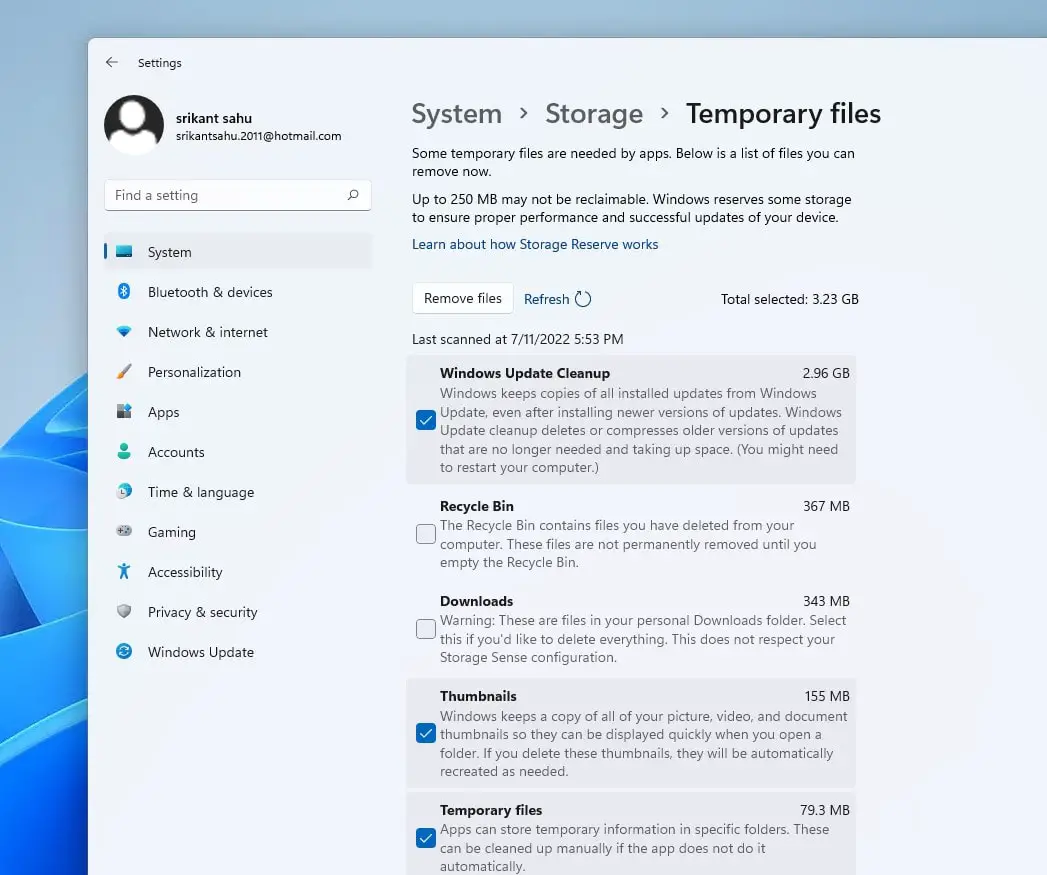

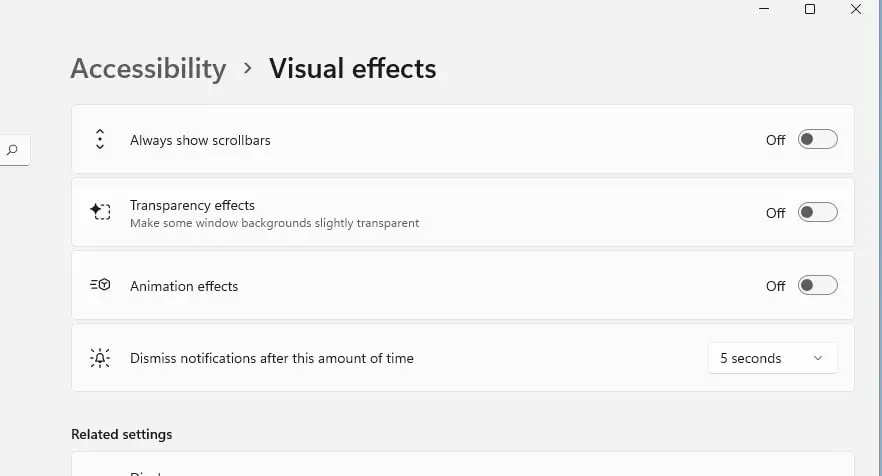

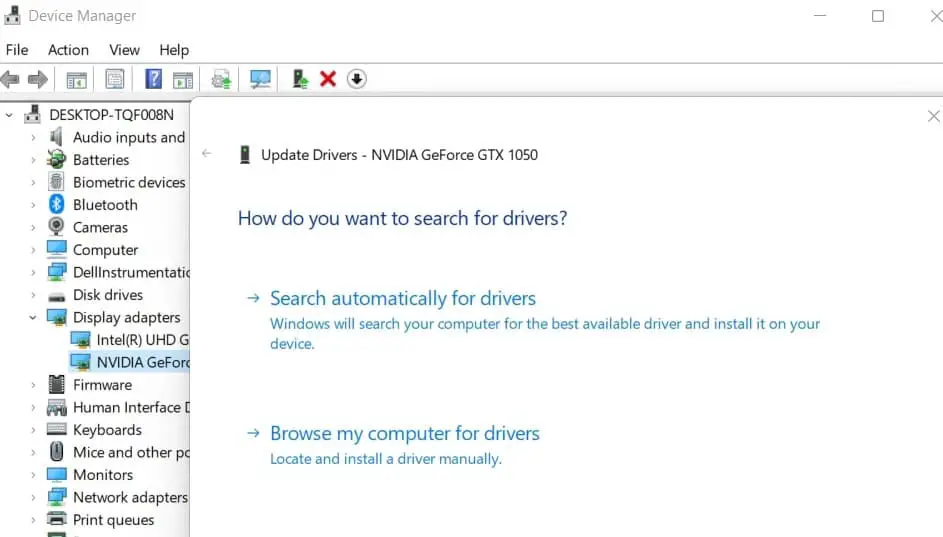

Шаг 5: делаем тех. оптимизацию страницы

Технически бодрый сайт без лагов и ошибок соберет гораздо больше качественного SEO трафика — никому не понравится лагающий или нерабочий ресурс. Что нужно сделать для грамотной настройки:

- Проверяем Robots.txt и Sitemap.xml для грамотной навигации проверяющего бота по сайту;

- Проводим склейку зеркал и перелинковку. Запросы типа www.site.ru, site.ru/index.html, site.ru/index.html/ и другие поисковый робот видит как разные страницы, что не очень хорошо. Поэтому сносим все дубли через файл .htaccess;

- Убираем страницы с некорректными ответами сервера. Это 400-е и 500-е ошибки — страница удалена или сайт не отвечает. Если 404-х на сайте много, бот расценит это как низкое качество ресурса и вы упадете в выдаче;

- Настраиваем скорость загрузки. Если современный сайт будет тупить даже 5 секунд, это может и будет раздражать пользователей. Плюс вездесущий бот отметит, что страница не отвечает запросу пользователя и опять понизит его в выдаче;

- Делаем удобную мобильную версию. Доля пользователей, которые сидят в сети с мобильных устройств — свыше 70%, поэтому в сегодняшних реалиях этот пункт — важная необходимость.

Техническая часть — это фундамент качественного продвижения сайта, и чем лучше вы все настроите, тем быстрее будете расти — это правило справедливо и в сфере iGaming.

Если, скажем, страница со слотом будет лагать и выдавать ошибки — на вас сразу выльют 10 грузовиков с обвинениями в скаме.

Шаг 6: создаем контент для страниц

Статьи, обзоры и топы должны быть не только интересными и информативными, но и оптимизированными с точки зрения SEO, поэтому каждому материалу нужны четкая структура и meta данные.

Что важно:

- Определите, что пользователь имеет в виду, используя те или иные слова при поиске. Например, «обзор казино Вулкан» и «Вулкан» — это разные вещи. Если оптимизировать по неправильным словам и конструкциям, результат вас не удовлетворит;

- Раскрывайте темы как можно глубже. Так ваша статья окажется выше работ конкурентов;

- Анализируйте рейтинги и обзоры с точки зрения SEO-копирайтинга. Тошнота, заспамленность, общее качество по разным сервисам анализа — хорошие показатели помогут урвать еще несколько позиций в поиске;

- Лучше всего работают большие структурированные статьи до 20 тыс. символов с подзаголовками, списками, таблицами, скриншотами, картинками и видео. Google-боты очень хорошо воспринимают такие материалы.

Качественные картинки не менее важны для SEO в гемблинге. Главное — не заливать слишком «тяжелые» изображения, иначе сайт будет загружаться медленнее. На что еще обратить внимание:

- Уникализация контента. Быстро подшаманить картинки поможет сервис imgfactory, после чего вставляем их в тексты и обязательно прописываем все атрибуты и alt-тексты. Для этого берется самый высокочастотный ключ;

- После уникализации сжимаем картинки до приемлемого размера — здесь поможет сервис ILoveIMG;

- Также можно изменить формат изображений на .webp, однако это опциональный шаг.

Шаг 7: работаем со ссылочным профилем

Ссылки особенно сильно влияют на ранжирование в Google. Принцип простой: чем больше качественных проектов ссылаются на ваш сайт, тем он лучше с точки зрения бота и тем больше трафика на гемблинг вы привлечете.

Сайт можно продвигать с помощью разных ссылок: крауд, аутрич, PBN и их комбинаций.

Для одностраничных ресурсов можно закупать и низкокачественные ссылки — это поможет сэкономить много денег. Также работает прогон и заказ на продвижение сайта через спец. сервисы:

Для накрутки поведенческих факторов можно воспользоваться биржами Userator и SERPClick.

Для больших проектов, цель которых — жить долго, лучше использовать высококачественные ссылки. Если в будущем вы решите продать сайт, с качественной ссылочной массой его заберут гораздо дороже.

Важно: не забывайте проверять качество каждой размещаемой ссылки. Для этого есть свои сервисы, например — CheckTrust.

Шаг 8: следите за отзывами и реагируйте на них

Для стабильного привлечения SEO трафика в гемблинге важно всегда смотреть за тем, какая слава о вашем сайте ходит по сети. Если видите много негатива, значит что-то делается неправильно и стратегию нужно пересмотреть. Хорошие отзывы тоже могут дать вам подсказки, над чем еще стоит поработать на сайте, поэтому изучайте и их тоже.

Адекватные реакции на отзывы помогут поднять вовлеченность пользователей и привлекут больше игроков — людям нравится, когда на их мнение обращают внимание.

Шаг 9: наращивайте авторитет своего ресурса

Работа с SEO трафиком в гемблинге — это всегда работа в долгую. Даже если вы быстро поднялись в поиске, эти результаты будут временными. Если же задача — извлекать прибыль из проекта по гемблингу месяцами и годами, сразу закладывайте на развитие проекта минимум полгода.

Итог

SEO продвижение в гемблинге любит внимательность к деталям, поэтому приготовьтесь к тому, что работать придется долго и усердно, однако и окупаются такие проекты хорошо.

Анализ рынка поможет выбрать, что именно продвигать и как это лучше сделать, чтобы не лезть в гонку с крупными партнерками, которым даже целые арбитражные команды могут проиграть из-за нехватки ресурсов.

Пользуйтесь нашей статьей как гайдом и лейте только качественный трафик на гемблинг в любом ГЕО!

Source: traffnews.com

Оказавшись в японском ресторане, вы несомненно сделаете заказ японской еды в традиционном стиле. При этом, при доставке суши и других блюд японской кухни очень важно придерживаться правил этикета при их употреблении. Единого и универсального порядка поедания блюд японской кухни не существует, однако есть особые правила, которые тривиальны и обычны для каждого японца, однако для наших соотечественников они отнюдь не очевидны.

Оказавшись в японском ресторане, вы несомненно сделаете заказ японской еды в традиционном стиле. При этом, при доставке суши и других блюд японской кухни очень важно придерживаться правил этикета при их употреблении. Единого и универсального порядка поедания блюд японской кухни не существует, однако есть особые правила, которые тривиальны и обычны для каждого японца, однако для наших соотечественников они отнюдь не очевидны.