В этой статье описывается процесс объединения двух офисов с помощью VPN протокола SSTP на базе двух роутеров MikroTik.

Архив автора: admin

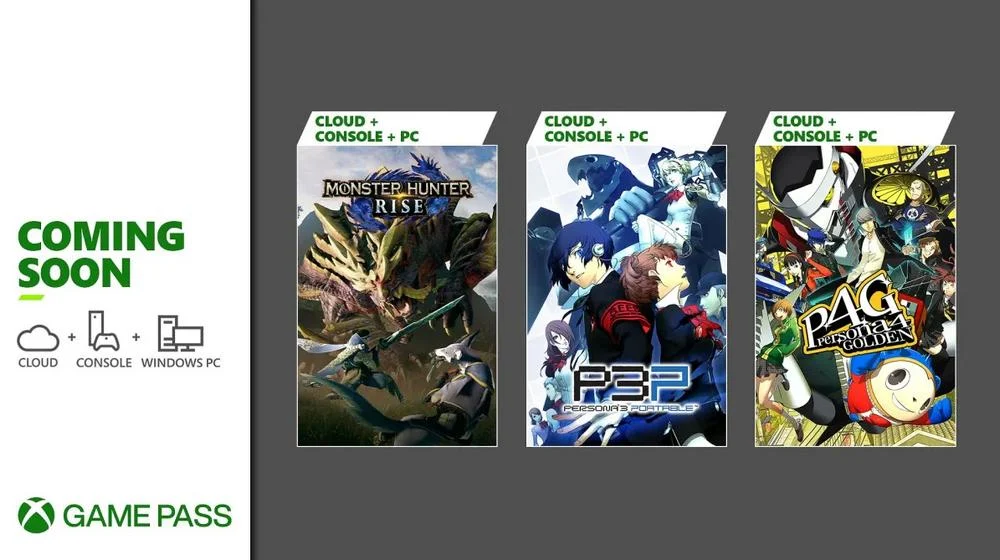

Microsoft начинает 2023 год с добавления трех превосходных игр в Xbox Game Pass

Microsoft объявила о выпуске январской линейки Xbox Game Pass, включающей три известные японские игры с длительным сроком службы, превышающим 100 часов.

Xbox Game Pass медленно начинает год после впечатляющего заключительного месяца, предлагая только:

- Persona 3 Portable (облако, консоль и ПК) — 19 января.

- Persona 4 Golden (облако, консоль и ПК) — 19 января.

- Monster Hunter Rise (облако, консоли и ПК) — 20 января.

Но не позволяйте их небольшому количеству обмануть вас; это ролевые игры, то есть часы и часы игры — если вам нравятся такие игры. Для 100-процентного завершения считайте около 160 часов для Monster Hunter Rise и 80+ часов для каждого из названий Persona.

Как обычно, некоторые игры покидают платформу 15 января, а именно:

- Danganronpa: Trigger Happy Havoc (облако, консоль и ПК)

- Никто не спасет мир (облако, консоль и ПК)

- Pupperazzi (облако, консоль и ПК)

- The Anacrusis (предварительная версия игры) (облако, консоль и ПК)

- We Happy Few (облако, консоль и ПК)

- Windjammers 2 (облако, консоль и ПК)

Странно видеть, как We Happy Few покидает Game Pass, поскольку его разработчик, Compulsion Games, принадлежит Xbox Game Studios — вероятно, это связано с тем, что права принадлежат Gearbox Software. К сожалению для тех, кто любит собирать достижения и как-то пропустил это, времени на их получение не осталось, так как для их прохождения требуется около 60+ часов.

Зелёный овощной суп с нутом

Простой рецепт веганского супа с использованием различных овощей для очищения и перезагрузки организма

Веганский тантанмен (рамен с кунжутом и соевым фаршем)

Радужный салат из стеклянной лапши, тофу и красной капусты

Красочный салат из стеклянной лапши с тофу и салатом из красной капусты с лапшой естественного цвета.

Немецкий капустный суп Kohlsuppe