Point E — это новый ИИ OpenAI для создания изображений.

OpenAI расширил возможности вашего текстового программного обеспечения aiдвух-трехмерное изображение с запуск Точка-Е, уна ИИ, который генерирует 3D-изображения из текстовых подсказок. Согласно опубликованному документу кодовой базы, Point-E не требует для работы высокопроизводительного компьютера и может создать модель менее чем за две минуты с помощью одного графического процессора Nvidia V100.

Таким образом, мы видим, что генераторы 3D-моделей могут стать следующим прорывом, который покорит мир искусственного интеллекта. OpenAI был очень активен в этом году, так как, например, здесь, в блоге, мы рассказали о двух крупных проектах компании: Dall-E 2 и ChatGPT.

Между этими двумя массивными платформами ИИ, компания помогла создать изображения и длинный текст из простого текстового сообщения, и теперь компания вернулась с третьей концепцией, которую она запустила незадолго до Рождества, чтобы пробудить всеобщий интерес. Эта третья концепция, получившая название Point-E, следует аналогичному шаблону, создавая 3D-контент из простых подсказок.

Объявлено в исследовательской статье, опубликованной командой OpenAI, Point-E работает в два этапа: первый использует ИИ для преобразования текста в изображение превратить вашу словесную просьбу в изображение, затем используйте вторую функцию, чтобы преобразовать это изображение в 3D-модель..

Point-E имеет открытый исходный код, и исходный код доступен на Github.. Тем не менее, это может быть немного сложно, поскольку пользователи должны быть хорошо знакомы с инструментами командной строки, а в системе должен быть установлен Python, в отличие от ChatGPT, где пользователи могут зарегистрироваться на веб-сайте и проверить свои навыки.

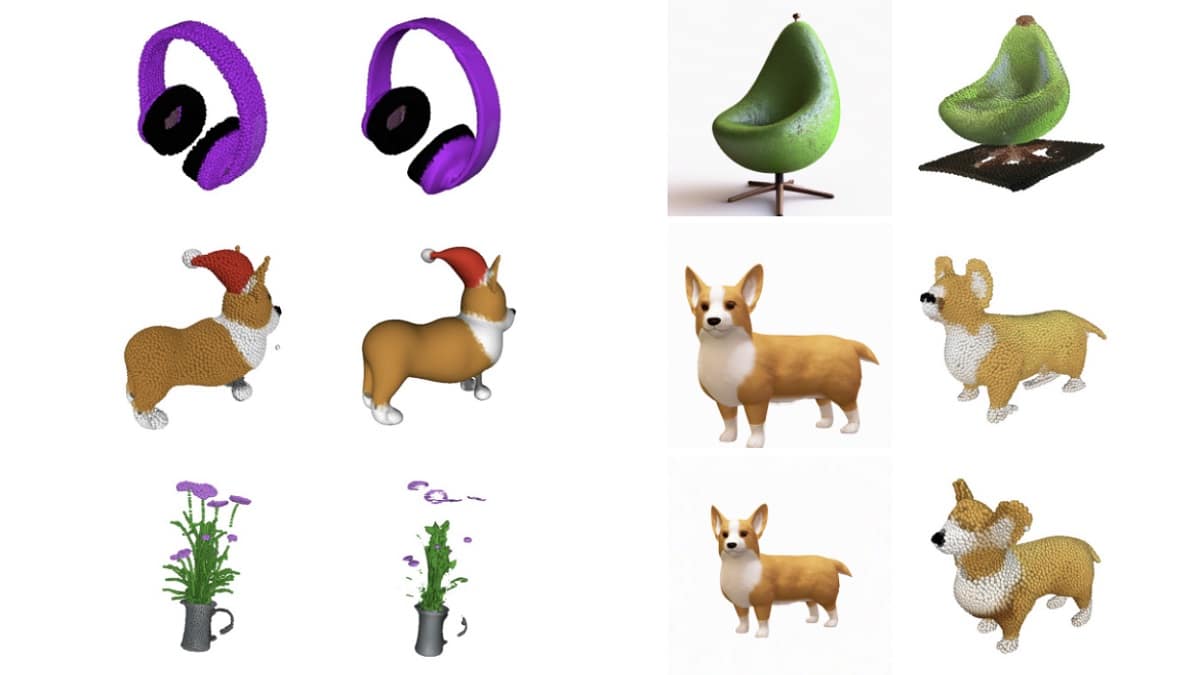

Point-E не создает 3D-объекты в традиционном понимании, скорее, он генерирует облака точек, то есть дискретные наборы точек данных в пространстве, которые представляют трехмерную форму, отсюда и дерзкая аббревиатура.

(«E» в Point-E — это сокращение от «efficiency», так как это явно быстрее, чем предыдущие подходы к рендерингу 3D-объектов.) По словам разработчиков, облака точек легче синтезировать в вычислительном отношении, но они не фиксируют форму или тонкую текстуру объекта, что в настоящее время является основным ограничением Point-E.

Чтобы избежать этого ограничения, команда Point-E обучила дополнительную систему искусственного интеллекта для преобразования облаков точек Point-E в сетки. (Сетки, наборы вершин, ребер и граней, которые определяют объект, обычно используются в 3D-моделировании и дизайне.) Но исследователи они указывают в своей статье о том, что модель иногда может пропускать части объектов, что приводит к искажению или блокировке форм. Помимо автономной модели генерации сетки, Point-E состоит из двух моделей: модели текстового изображения и модели трехмерного изображения.

Модель текст-изображение, аналогичная системам генерации иллюстраций, таким как DALL-E 2 и Stable Diffusion, обучен на помеченных изображениях, чтобы понять ассоциации между словами и визуальными понятиями. Модель 3D-изображения, с другой стороны, была снабжена набором изображений, связанных с 3D-объектами, чтобы научиться эффективно преобразовывать их. При получении текстового сообщения, например «3D-печатная шестерня, одна шестерня диаметром 7 см и толщиной 1 см», модель преобразования текста в изображение Point-E генерирует визуализированный синтетический объект, который переходит на изображение. -3д модель.

Последний затем генерирует облако точек. По словам исследователей OpenAI, после обучения моделей на наборе данных из «нескольких миллионов» 3D-объектов и связанных с ними метаданных, Point-E смогла создать цветные облака точек, которые часто совпадали с текстовыми подсказками. Не идеально: модель 3D-изображения Point-E иногда не понимает изображение из модели текстового изображения, в результате чего форма не соответствует текстовому сообщению. Тем не менее, это намного быстрее, чем предыдущий уровень техники, по крайней мере, по словам команды OpenAI.

Результат далек от качества коммерческого 3D-рендеринга в кино или видеоигре. Но этого не должно быть. Как только они загружаются в 3D-приложение, такое как Blender, их можно превратить в текстурированные сетки, которые больше похожи на обычные 3D-изображения.

«Хотя наш метод все еще не на высоте с точки зрения качества выборки, он на один или два порядка быстрее, что является практическим компромиссом для некоторых вариантов использования», — объясняют исследователи OpenAI в документе, описывающем проект.

Наконец да вы заинтересованы в возможности узнать исходный код или больше о Point-E вы можете проверить подробности в по следующей ссылке.